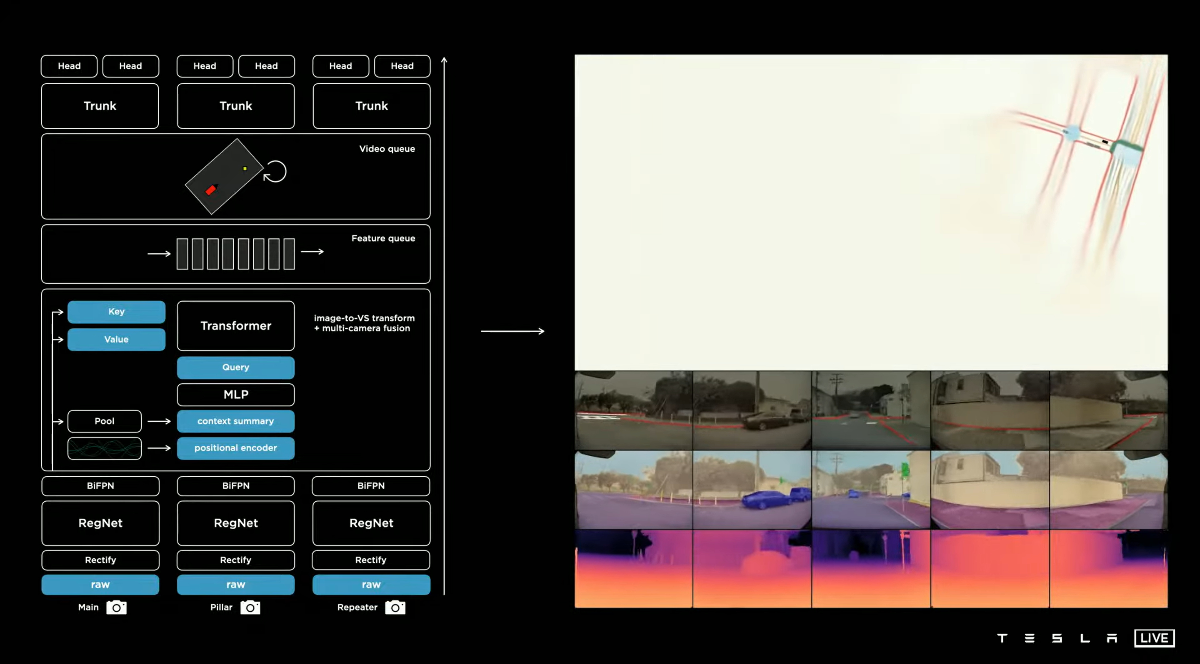

特斯拉 Autopilot 软件工程总监 Ashok Elluswamy 在 CVPR 2022 上发出来的 FSD Beta 最新的感知架构,时隔一年,和去年 Andrej Karpathy 时代的感知架构大的框架一致,深入到细节调整也不少。

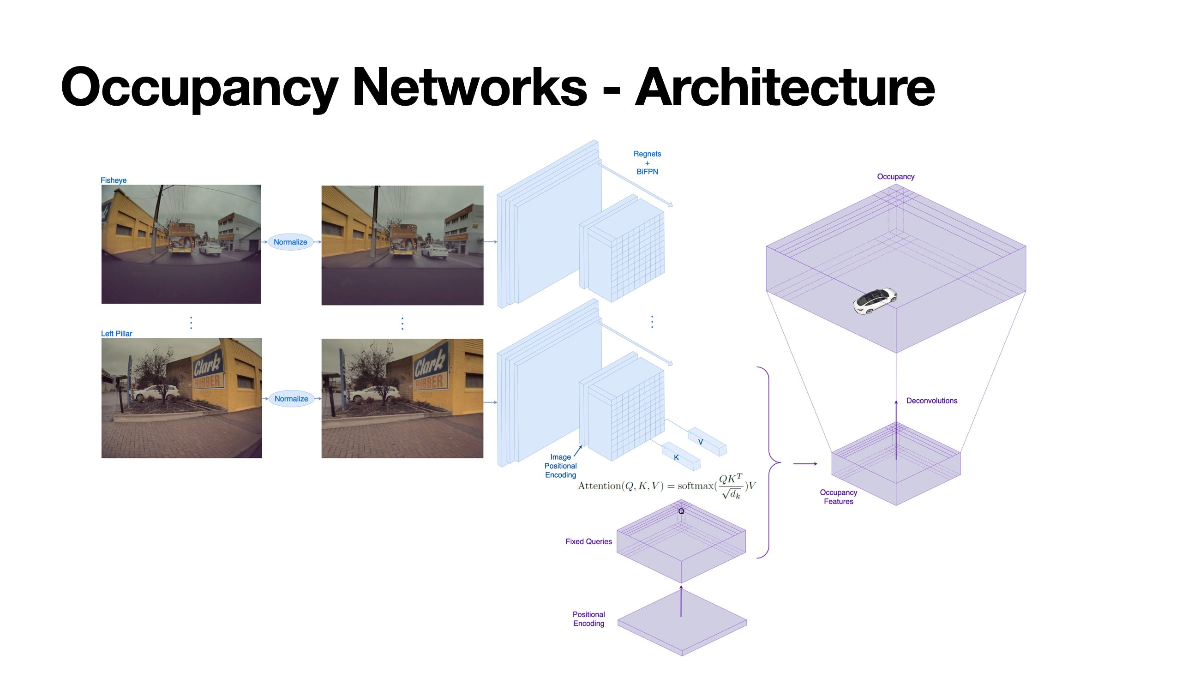

名称也微调了~,虽然没啥区别,Andrej 叫 Occupancy Tracker,Ashok 这次叫 Occupancy Networks:

- 预测几何占用率

这个就是前几天大疆官微说的「任意障碍物的识别与应对」,本质是用摄像头实现 LiDAR 的感知性能。

- 使用多摄像头和视频流进行预测

就是 Elon Musk 之前说的 4D 架构,基于时间序列的视频流。

- 预测动态占用流

不解释。

- 持续跟踪遮挡的障碍物

举个例子,一个人从左往右过马路,走到了左前大巴前面,大巴完全挡住,2D 感知里这人就跟丢了,消失了;Occupancy Networks 知道这人走到一半被大巴挡住了,还在往右走,马上会出现在本车前方,所以会谨慎做规划控制。跟人一样联想预测。

- 重点位置高分辨率

稀疏化计算,同样模仿人类大脑。

人在开车的时候,其实并不是全局视野分享全部的注意力,而是只关注整个视野内少数重要的部分,而且重点在持续动态变化。

比如常规是关注前方的车辆,突然冲出来一个老头乐插进来,这个老头乐立马吸引最高的注意力——同时前方车辆的关注其实下降了~而且人开车的时候,在持续录入看到的信息的同时,也在飞快的忘掉没用的信息。

这是因为人的内存和算力都有限,所以进化出了极为高效的稀疏计算方式,抓大放小,只关注真正影响全局,会导致驾驶决策改变的部分。

- 高效的内存和计算

正如前面,稀疏计算,再加上一些底层软件工程和通信的优化,效率很高。

- 运行速率约为 10 毫秒

这个指标主要是考虑到复杂的交叉路口和拥堵的大型停车场,对低延迟的要求极高。因为没有 HD Map 这样的先验信息,时间紧,任务重,实时的感知和决策。

没啥可说的,这是目前量产车上最领先的智能驾驶感知架构,没有之一。

https://www.youtube.com/watch?v=jPCV4GKX9Dw